26 februari 2026 4 minuten leestijd

AI ontwikkelt zich razendsnel. Waar we eerst werkten met slimme chatbots die antwoord gaven op vragen, zien we nu een volgende stap: AI assistenten die zelfstandig taken uitvoeren binnen jouw digitale werkomgeving.

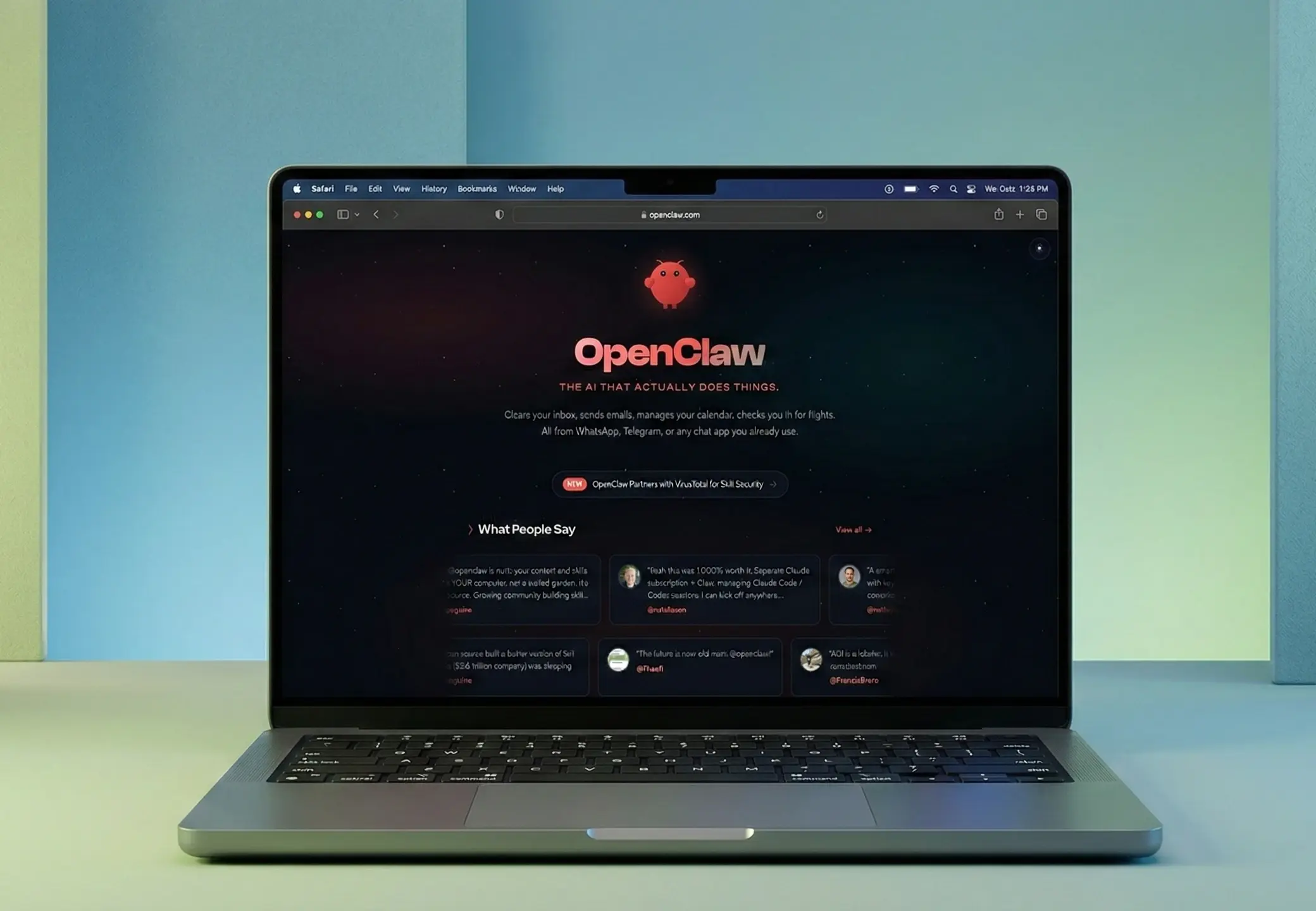

OpenClaw is daar een opvallend voorbeeld van. Een AI assistent die e mails verwerkt, afspraken plant en werkzaamheden automatiseert zonder dat jij elke stap hoeft te controleren.

Dat klinkt als de toekomst. Maar het roept ook een belangrijke vraag op: hoe veilig is dit?

In deze blog bespreken we wat OpenClaw is, waarom het zoveel aandacht krijgt en wat dit betekent voor organisaties die AI verantwoord willen inzetten.

.png?width=900&height=1200&name=Kopie%20van%20blog%20stories%20(2).png)